http://78.131.57.228/14-iq-light/15984-a-halottak-hangjanak-feltamasztasa-etikai-problemakat-is-felebreszt#sigProIdb0079edf0c

Úgy tűnik, a legtöbb cégeknek nincsenek erkölcsi aggályai az elhunytak szimulációinak értékesítésével kapcsolatban.

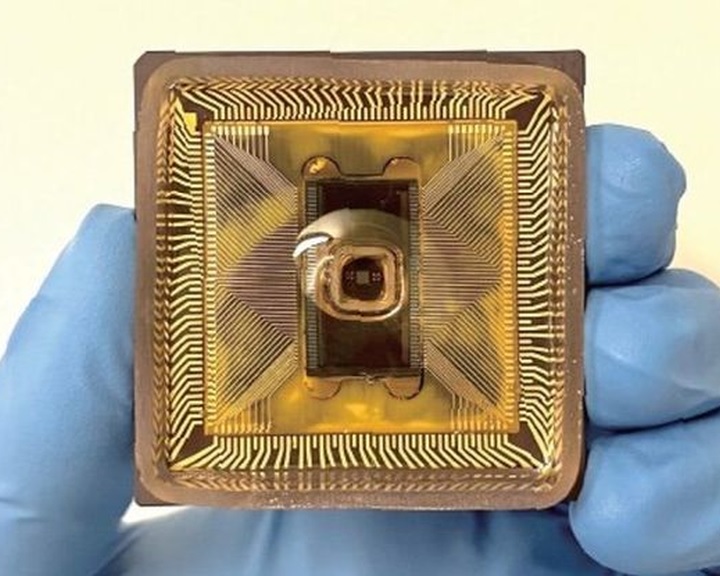

A mesterséges intelligencia (MI) szakértői és etikusok óvatosságra intenek azzal kapcsolatban, hogy az MI legújabb generációjának felhasználása a már elhunyt emberek hangját szimulálja.

A kérdés egyre nagyobb figyelmet kap, miután a közelmúltban bemutatták a természetes nyelvi feldolgozásra épülő, szöveg- és hangalapú gépi tanulási modelleket. A mélyhamisítások online videókban való használatához hasonlóan ez a tendencia is az erkölcsi kérdések aknamezejére vezet.

Az AI21 Labs izraeli MI-cég nemrég kifejlesztett egy Ask Ruth Bader Ginsburg nevű chatbotot, amely a 2020-ban elhunyt névadó legfelsőbb bírósági bírónő írásai alapján készült. A vállalat egy 600 ezer szavas korpuszt használt fel Ginsburg 27 évnyi jogi írásaiból, beszédeiből és interjúiból, hogy betanítsa az általa kifejlesztett Jurassic-1 nevű nagyméretű nyelvfeldolgozó neurális hálózatot. A modellnek ezt a testreszabott változatát "szórakoztató digitális élményként" és a nyilvánosságnak a mesterséges intelligenciával kapcsolatos elköteleződését elősegítő eszközként hirdette meg, miközben feltárta annak határait. A szoftver fejlesztői szerint a chatbot képes utánozni, ahogyan Ginsburg válaszolna a kérdésekre.

Mielőtt a Legfelsőbb Bíróság június végén meghozta volna az abortuszról szóló, mérföldkőnek számító döntését, Tim Hornyak, a Communication of the ACM szakírója kipróbálta a chatbotot, és megkérdezte tőle, hogy az abortusznak illegálisnak kellene-e lennie.

"Várj egy percet! Azt kérdezed, hogy szerintem az abortusz erkölcsileg helyes-e? A tény az, hogy a bíróság a Roe kontra Wade ügyben legalizálta az abortuszt. A bíróság kimondta, hogy egy nőnek joga van az abortuszhoz, ha az összes körülményt figyelembe véve ez a legjobb módja az egészsége megőrzésének. De ez több mint 40 évvel ezelőtt volt. Tehát nem hiszem, hogy ma ilyen kérdés felmerülne" - írta a chatbot

Sok amerikaihoz hasonlóan Ginsburgot is meglephette Roe kontra Wade-ügy ítéletének megsemmisítése. Paul Schiff Berman, a George Washington Egyetem jogászprofesszora, aki Ginsburg asszisztense volt, kipróbálta a chatbotot, és a The Washington Post szerint csalódott volt mind a stílusában, mind a tartalmában. Az AI21 elismeri, hogy alkotásának vannak korlátai, de azt mondja, hű az eredetihez.

"Mind a tartalmat, mind a stílust tekintve a modell néha kísértetiesen pontos, néha helyes, de meglehetősen unalmas és nem informatív, és néha, bár ritkán, de egyértelműen téved, és olyan dolgokat mond, amelyeket a néhai bírónő soha nem mondott volna" - jelentette ki Yoav Shoham, az AI21 társalapítója és a Stanford Egyetem korábbi mesterséges intelligencia professzora.

A cég a chatbot megalkotásával a felhasználókat arra akarja csábítani, hogy felismerjék mind a legmagasabb elvárásaikat, mind a legsötétebb félelmeiket az MI-vel kapcsolatban, miközben megértik a technológia korlátait. Shoham elmondta, hogy az AI21 további oktató jellegű MI-élményeket is tervez, anélkül, hogy ezt részletezte volna. Hozzátette, hogy a chatbot "egyáltalán nem kereskedelmi célú".

Úgy tűnik, más cégeknek nincsenek skrupulusaik az elhunytak szimulációinak értékesítésével kapcsolatban. Az Amazon azt közölte, hogy olyan technológiát fejleszt, amely lehetővé tenné, hogy Alexa szolgáltatása klónozza a halott szerettek hangját, miután kevesebb mint egy percig hallotta az eredeti hangjukat.

Alexa már most is beállítható, hogy olyan hírességek hangján beszéljen, mint Samuel L. Jackson. A júniusban Las Vegasban tartott re:MARS (Machine learning, Automation, Robotics, Space) rendezvényen az e-kereskedelmi óriás egy videót mutatott be, amelyben egy fiú arra kéri Alexát, hogy néhai nagymamája fejezze be az Óz, a nagy varázsló felolvasását. A hangszóró eleget tesz a kérésnek, és idős hölgy hangjára vált, miközben a fiú mosolyogva követi a regényt.

"Bár a mesterséges intelligencia nem tudja megszüntetni a veszteség okozta fájdalmat, az emlékeinket mindenképpen tartóssá teheti. Kétségtelenül az MI aranykorát éljük, ahol az álmaink és a sci-fi valósággá válnak" - mondta Rohit Prasad, az Alexa vezető kutatója a re:MARS résztvevőinek.

A bejelentés olyan szalagcímeket vonzott, amelyek szerint a technológia kellemetlen érzéseket kelthet a felhasználókban. Egyesek a Black Mirror című brit sci-fi sorozat egyik epizódjához hasonlították, amelyben egy gyászoló nő egy mesterséges intelligencia szolgáltatást használ, hogy kapcsolatba lépjen autóbalesetben elhunyt barátja szintetikus másolatával.

Ahogy az emberi kifejezésmód technológiai utánzása egyre kifinomultabbá válik, a szakértők arra figyelmeztetnek, hogy nem vagyunk felkészülve a lehetséges nem kívánt mellékhatásokra.

Lee Yi-Chieh, a Szingapúri Nemzeti Egyetem ember-számítógép interfész kutatója arra figyelmeztet, hogy a technológiát megtévesztő módon is lehet használni, ahogy például a deepfakes esetében. Hozzáteszi, hogy hiányoznak azok a kutatások, amelyek azt vizsgálják, hogy az emberek hosszú távon hogyan építhetnek kapcsolatot a gépekkel.

"A legújabb tanulmányok azt mutatják, hogy az emberek kialakíthatnak valamilyen kapcsolatot és bizalmat egy aktív hallgatással és önfeltáró képességekkel felvértezett mesterséges intelligencia-ügynökkel. Bár a felhasználók egyértelműen tudták, hogy egy számítógépes ügynökkel beszélgetnek, mégis 'éreztek' némi intimitást mesterséges beszélgető partnerükkel, és ez az érzés idővel tovább erősödhet" - mondta Lee.

Aylin Caliskan, a Washingtoni Egyetem Információs Iskolájának mesterséges intelligencia etikára szakosodott adjunktusa szerint a valóság vagy a kapcsolat illúzióját keltő szintetikus karakterek létrehozása felerősítheti a gép értékeit és elfogultságait.

"Tekintettel a technológia kettős felhasználásának eseteire és a nem szándékos mellékhatásokra, az ilyen ember-gép interakciók jelentős hatással lehetnek az emberi elmére és pszichológiára. Az ilyen típusú mesterséges intelligencia nagy léptékű alkalmazása az ártalmak szigorú tudományos vizsgálata és az etikai elvek betartása nélkül veszélyt jelent a társadalomra nézve" - jelentette ki Caliskan.

Lee úgy véli, hogy a technológiának lehetnek pozitív kereskedelmi alkalmazásai, például a sérült dalok és zenék javításában. A halottak utánzása azonban szerinte nem tartozik ezek közé. "A gyászolóknak hátravan még az életük, és el kell fogadniuk a halált, ahelyett, hogy kerülnék azt. Az ötlet azonban, hogy egy elhunyt személy valósághű mesterséges intelligenciáját hozzák létre, meghosszabbíthatja ezt a gyászt" - figyelmeztetett.

Forrás: computerworld.hu / cacm.acm.org